Glas statt Kupfer! 10 Apr 2021 2:13 AM (3 years ago)

Es hat länger gedauert als gedacht, die Auslastung der Fachfirmen und die Pandemie haben die Arbeiten verzögert. Aber seit gut zwei Wochen haben wir hier unseren Internetanschluss via Glasfaser. Ein richtiger Glasfaseranschluss. Die Faser endet in meinem Arbeitszimmer hinter der Yukka.

Nicht so eine Verarschung wie es Vodafone mit dem “Kabel-Glasfaser” macht. Da wird einem ein technischer Fäkalienhaufen mit Gold überzogen. Er stinkt trotzdem.

Glücklicherweise hatten wir keine große Not, VDSL bietet ja noch genug Bandbreite. Die Glasfaser ist hier Infrastruktur für die Zukunft, die ist aber vermutlich näher, als wir glauben. Einige Nachbargemeinden im Ausbaugebiet hatten aber nicht so viel Glück und Bandbreite wie wir. Die haben sehnsüchtiger gewartet.

Und auch wenn ich bisher nicht wirklich das Gefühl hatte langsam zu sein muss ich doch sagen, dass der Anschluss schon Spaß macht .

.

Gebucht sind 200/50MBit/s, im ersten Jahr gibt es 400/100 zum gleichen Preis. Ein 2GByte Download aus der Mediathek (Akamai) dauert irgendwas unter einer Minute. Ich werd da bei Gelegenheit mal ausprobieren, ob es sich da lohnt, das TCP Receive Window zu optimieren.

Noch bis Mitte Mai läuft der VDSL Anschluss parallel, bis auf die Haupt-Telefonnummern habe ich schon alles auf der neuen Leitung. Die Nummern sind bei 1&1, ich kann über den neuen Anschluss problemlos damit raustelefonieren, aber eingehende Rufnummern werden nur auf der 1&1 Leitung signalisiert. Sei’s drum, die Rufnummern werden danach zu Sipgate portiert, das funktioniert mit einer anderen Sipgate-Basic und einer Sipgate-Teams Nummer schon jetzt zuverlässig.

Der neue Anschluss ist ein reiner Internetanschluss, Telefonie haben wir nicht gebucht. Die würde als Flatrate 10€ kosten und wir telefonieren maximal ein paar Minuten im Monat via Festnetz. Das lohnt sich nicht und wenn sich das ändert kann ich für 10€ auch bei Sipgate eine Flatrate buchen. VoIP ist nicht nur für die Infrastruktur billiger, auch für den Anwender ist es flexibler. Ich trauere zwar noch immer der Redundanz und Zuverlässigkeit des POTS hinterher, aber die Zeit des Festnetz ist vorbei.

Dass beide Anschlüsse parallel laufen war gewollt, ich wollte sicher sein, dass die Internetkonnektivität einwandfrei funktioniert. Dass ist in der aktuellen Situation mit Home Office noch wichtiger. Außerdem wollte ich in Ruhe meine eingehende Verbindung von außen konfigurieren.

Der Glasfaseranschluss und Internetkonnektivität kommt von GVG Glasfaser/Nordischnet, die konnten nicht wie die alteingesessenen Provider große IPv4 Adresspools sichern. Der Anschluss ist also DS-Lite, sprich IPv6 nativ und IPv4 via Tunnel. Das ist grundsätzlich überhaupt kein Problem für die Verbindung nach außen, der gesamte im Vergleich winzige IPv4 Adressraum ist in IPv6 ja einfach mit drin.

Auch eingehende Verbindungen sind grundsätzlich kein Problem, da jedes Gerät direkt erreichbar sein kann sogar einfacher weil man sich den NAT Unfug sparen kann (NAT ist keine Firewall!). Aber um einen v6 Anschluss zu erreichen muss man selbst auch an einem IPv6 Anschluss sein. Das ist bei VDSL Anschlüssen normalerweise der Fall, die haben beide Adressen. Und mit ner Fritzbox funktioniert das auch einfach so. Bei den Telekom-Routern bin ich nicht sicher, die haben in vielen Bereich ihre Eigenarten. Im (Telekom) Mobilfunknetz habe ich auch schon lange eine IPv6 Adresse am Smartphone.

Bei vielen Freunden mit VDSL ist das also kein Problem, auch unser Firmennetz spricht nativ IPv6. Aber bei öffentlichen Hotspots könnte es hakeln und ich habe gerade da gern mein VPN nach Haus um darüber zu surfen — warum sollte ich bei der Bandbreite Geld für einen kommerziellen Anbieter ausgeben?

Aber auch das war schneller geregelt als vermutet, dass es ein kein echtes Problem wird war mir aber schon vorher klar.

Was und wie ich die IPv4⇒IPv6 Konnektivität eingerichtet habe schreib ich nochmal extra auf, thematisch passt das besser als eigener Artikel.

Datenspeicher: Wolken überall, auch zu Hause 8 Apr 2021 8:37 AM (3 years ago)

Meine Daten sichere ich möglichst breit, auf dem Ursprungsgerät können sie zu leicht verloren gehen bei einem Defekt oder Verlust. Sei es PC, Chromebook (Laptop/Tablet) oder Smartphone.

(Fast) alle Daten landen auch auf auf einem Raspberry PI mit 2× 2TB Platten. Entweder im lokalen Netzwerk direkt oder mobil über Syncthing.

Das ist quasi mein “Heimcloud”.

Vieles wird außerdem in meine Nextcloud auf dem Webspace gesichert, der auch dieses Blog beherbergt. Das betrifft vor allem Medien und Daten, auf die ich einfach von überalle zugreifen können will. Dazu noch Daten, die keinesfalls verloren gehen sollen, wenn die Bude abfackelt.

Das ist also meine eigene (Next-) Cloud.

Ganz wichtige Dinge/Dokumente sichere ich dazu noch mit Duplicati2 verschlüsselt im Google Drive. Dafür leiste ich mir für 30€/Jahr das 200GB Paket. Duplicati sichert regelmässig alles was sich geändert hat ausgehend von meinem PC und dem Raspberry PI. Duplicati ist was die Cloudspeicher angeht sehr flexibel und hat als Open Source Programm für mich den riesigen Vorteil, dass ich mir im schlimmsten Fall keine Gedanken darüber machen muss, wie ich an die kommerzielle Software oder dessen Lizenz kommen kann. Ich habe sie auf einem USB-Stick dabei oder kann sie bei Bedarf einfach runterladen.

Sicher geht das auch mit vielen kommerziellen Programmen, aber Geschäftsmodelle ändern sich und auf den Benutzeraccount mit der Lizenz habe ich evtl. keinen einfachen Zugang mehr wennn das Gerät für die 2FA auch nicht mehr verfügbar ist. Bei einer etablierten Open Source Software habe ich da ein besseres Gefühl.

Mit diesem Setup war und bin ich soweit zufrieden, die immer voller werdenden Festplatten am PI erforderten aber eine Aufrüstung. Und endlich auch eine Lösung für einen möglichen Festplattenausfall. Am PI hängen ja schon 2 Platte plus eine SSD für das Betriebssystem, eine dritte Platte erschien mir nicht zweckmässig.

Also habe ich mich doch mal mit einem NAS beschäftigt. Eigentlich war ich immer der Meinung, das ist im Prinzip auch nur etwas wie mein PI mit seinern Festplatten. so ganz falsch ist das nicht, aber wenn man sein NAS mittel Raspberry PI selbst baut merkt man schnell die Limitierungen, die man umschiffen muss. Die Platten kann man nur per USB anbinden, seit dem PI4 immerhin per USB3. Aber Dinge wie das RAID muss man von Hand machen, die Software auch selbst zusammenstellen usw.. Praktisch gemacht habe ich das trotz jahrelangem Einsatz mehrerer PIs nicht und im Vergleich zu den NAS und SAN Systemen die ich aus meiner Arbeitswelt kenne wäre es immer selbst zusammengeschustert und Funktional nicht vergleichbar.

Mein Entschluss zur Erweiterung der Speicherkapazität im Netzwerk auf ein “richtiges” NAS zu setzen stand relativ schnell. Von der Anforderung her sollte es aber ein einfaches System bleiben. Speicherplatz mit etwas Zusatznutzen, nicht mehr. Bei Kollegen ist das NAS ein größerer Server der auch als Host für virtuelle Systeme dient. Das brauche und will ich nicht.

Nicht zuletzt kostet Rechenleistung auch Strom und man kann da auch mal gegenrechnen, was die Pakete in Terabyte-Größe im Vergleich bei den üblichen Cloudanbietern kosten.

Ein einfaches NAS sollte es also sein. Erweiterbar, also nicht nur ein Fesplattenslot. Und für die Ausfallsicherheit sollte auch ein Festplattendefekt nicht zu Datenverlusten führen. In Kombination bedeutet das mindestens 3 Festplattenslots für ein RAID 5. Praktisch also 4 Slots.

Bei den großen Anbietern Synology und QNAP sind die leistungsmässig einfachern Modelle die in die engere Wahl kamen die Synology DS420j und das QNAP TS-431K.

Von den technischen Daten her vergleichbar, beide mit Quadcore ARM CPU mit 1GB RAM und 4 Slots. Der Funktionsumfang der Software ist auch vergleichbar. Die Unterschiede liegen im Detail. Synology hat ein 64Bit CPU, QNAP nur 32Bit. Den Arbeitsspeicher sehe ich aber als das härtere Limit. Die Synology hat einen GBit LAN Anschluss, QNAP derer 2. Das ist nett, aber privat sind sowohl load balancing als auch failover nicht wirklich relevant. Bei Synology liegt das Betriebssystem am Anfang der Festplatten, QNAP hat für das System einen Flashspeicher mit 2 Partitionen über die man im Fehlerfall auf das alte System wechseln kann. Installierte Programme landen aber auch auf den Festplatten. Der Stromverbrauch ist bei beiden relativ gering, das Synology benötigt aber noch etwas weniger als das QNAP.

Auch preislich sind sie fast gleich.

Bei mir ist es dann das QNAP TS-431K geworden. Einen wirklich harten Grund, der gegen Synology sprach gab es nicht. Es war ein Bauchgefühl, ich glaube ich hatte bei QNAP längere Supportzeiten gesehen. Aber letztlich sind beide so ähnlich, dass auch die Farbe des Gehäuses den Ausschlag geben könnte

Bestückt habe ich es direkt mit einer 8TB Platte, ein stinknormales Modell, nichts NAS optimiertes. Bei nächster Gelegenheit habe ich dann eine Zweite dazu gesteckt, sie kam aus einer externen Wechselplatte. Die werden wohl aus Marketinggründen billiger angeboten, als die internen Modelle.  Vorsicht: bei 2,5” Modellen scheint es üblich zu sein, dass in externen Modellen kastrierte Versionen stecken, die nicht einzeln funktionieren. Bei 3,5” scheint das noch nicht der Fall zu sein.

Vorsicht: bei 2,5” Modellen scheint es üblich zu sein, dass in externen Modellen kastrierte Versionen stecken, die nicht einzeln funktionieren. Bei 3,5” scheint das noch nicht der Fall zu sein.

Ja, Desktopplatten sind nicht für ein NAS gedacht, privat habe ich aber seit ich Computer mit Festplatten habe noch keinen Ausfall gehabt, also seit etwa einem Vierteljahrhundert. Da die NAS Platten gut das Doppelte kosten, ich deren höhere Leistung nicht benötige und die Daten durch das RAID den ausfall einer Platte verkraften ist das eine Wette, die ich ohne Bauchschmerzen eingehe. Falls eine Platte ausfällt muss ich sie ersetzen ehe die Nächste ausfällt. Wenn das passiert muss ich natürlich rechnen und abschätzen, was für ein Modell ich dann kaufe.

In meinem privaten Umfeld habe ich drei Freunde, die seit Jahren insgesamt 4 NAS Systeme mit Desktopplatten einsetzen und da ist noch keine ausgefallen. Ich bin also optimistisch.

Da ich aber sehr wohl in meiner beruflichen Erfahrung aber schon einen Totalverlust eines NAS hatte achte ich aber darauf, unterschiedliche Festplattenmodelle, mindestens aber unterschiedliche Chargen einzusetzen. Eine fehlerhafte Charge hatte damals zu geführt, dass die Hälfte der Platten gleichzeitig ausgefallen waren. Für meine Stück-für-Stück Erweiterung ist das fast automatisch kein Problem aber das als Hinweis falls Du mal ein NAS kaufen willst, das gleich mit mehreren Platten bestückt werden soll.

Beide Platten laufen jetzt als RAID 1, d.h. die Daten werden auf beiden Platten gespiegelt. Die Kapazität sind also weiterhin 8TB. Die Migration von der einzelnen Festplatte zum RAID macht das NAS im Hintergrund.

Wenn mir mal wieder ein Angebot über den Weg läuft kommt dann die dritte Platte ins Gehäuse, dann wird das RAID zu einem RAID 5 migriert. Dabei werden die Daten nicht mehr nur simpel gespiegelt, sondern über alle Platten verteilt und mit Paritätsinformationen abgesichert. Eine Platte kann in so einem Verbund ohne Datenverlust ausfallen. Die Gesamtkapazität steigt dann also auf 16TB, wenn ich eine vierte Platte dazustecke auf 24TB.

Das sollte eine Weile reichen, momentan nutze ich knapp 3,5TB. Es sind aber noch nicht alle Gerätebackups konfiguriert…

Damit ein paar Worte zu meiner Nutzung des NAS:

Den größten Teil nehmen momentan Mediendateien ein. Auf dem NAS läuft ein Plex-Server, der die lokalen Medien wie ein lokales Netflix bereitstellt. Das ist wirklich sehr angenehm (wäre genauso aber auch schon auf dem Raspberry PI gegangen). Ich werfe die Datei in den Bibliotheksordner, z.B. für Filme, und der Server erkennt am Dateinamen idR. automatisch den Film und lädt dessen Metadaten. Die Mediathek wird dann auch sehr ähnlich zu Netflix, FireTV und Co. präsentiert inklusive verweise zu ähnlichen Filmen.

Ein nettes Gimmick haben (nur?) Serien dabei: auf deren Übersichtsseite läuft im Hintergrund leise das Titelthema der Serie. Da fühlt man sich schon vor dem Start auf der Orville .

.

Da es mit Plex wirklich einfach geht und man auch die Streaming-üblichen Funktionen hat wie den im Wohnzimmer angefangenen Film im Schlafzimmer an der gleichen Stelle fortsetzen zu können, habe ich in den letzten Wochen meine ganzen DVDs auf das NAS kopiert und auch die aus den Mediatheken gespeicherten Sendungen dorthin verschoben. Seitdem gucke ich sie auch wieder öfter, wenn man die Wahl hat zwischen Netflix und zum Regal gehen gewinnt meistens Netflix . Seit der Inhalt des Regals auch über die Fernbedienung erreichbar ist, ist es wieder gleichwertig. Ja, Corona macht faul

. Seit der Inhalt des Regals auch über die Fernbedienung erreichbar ist, ist es wieder gleichwertig. Ja, Corona macht faul

Die kostenpflichtigen Funktionen von Plex brauche ich nicht, von daher belasse ich es erstmal bei der kostenlosen Version. Dass Plex Serverbasiert arbeitet hat praktische Vorteile gegenüber z.B. Kodi wo jeder Client alle aufgaben übernimmt. Aber Plex benötigt einen Account und für dessen Authentifikation eine Internetverbindung. Offline hat man also auch keinen Zugriff auf die lokalen Dateien. Dafür ist auf dem NAS noch ein DLNA Server aktiv, auf den der Fernseher auch direkt zugreifen kann. Und zur Not muss ich halt doch zum Regal gehen und die Scheibe rausholen

Zweiter wichtiger Punkt meiner Nutzung ist die Datenauslagerung von den Geräten. Einerseits Daten, die auch wirklich von mehreren Geräten genutzt werden, wie z.B. meine Calibre Bibliothek. Darauf greifen sowohl mein PC als auch mein Raspberry PI 4 zu. Andererseits ist es für alle Geräte ein sicherer großer Datenspeicher, der über das Gigabit LAN auch schnell genug für die meisten Anwendungen ist.

Dritter Punkt ist das Backup, hier muss ich noch am Meisten konfigurieren. Teilweise sind die Wege schon umgelagert vom PI auf das NAS, andererseits bietet das NAS auch mehr Möglichkeiten als ich auf dem PI eingerichtet hatte. Da meine Backups weiterhin wie gewohnt laufen und ich es vermeiden will hier einfach “irgendwas” zu konfigurieren, vor allem Plattenplatz/Freigaben umzukonfigurieren, lasse ich mir hier etwas Zeit. Nutze ich die Software von QNAP oder etwas Anderes? Eine Backup-Freigabe für alle Geräte oder -Art oder -Nutzer? Wie konfiguriere ich die Snapshots um Verschlüsselungstrojanern den Schrecken zu nehmen? Was sollte neben den Dokumenten überhaupt gesichert werden? Solche Dinge halt. Bisher habe ich das Backup für meinen privaten Linux-PC gemacht, das ist verhätlnismässig einfach. Hast Du dein Homeverzeichnis ist das Linux drumherum zweitrangig. Aber es soll ja auch für den Laptop der Herzdame funktionieren und auch wenn mein Windows 10 Zweitsystem nicht so wichtig ist kann ich mir da ja auch im Zweifelsfall Arbeit ersparen wenn ich die richtigen Daten gesichert habe.

Wie man sichert ist mir da eigentlich klar, ich will wie gesagt hauptsächlich strukturelle Umkonfigurationen am NAS vermeiden. Und da habe ich halt keinen Druck.

Die weiteren Sicherungsebenen laufen weiterhin wie ganz zu Anfang beschrieben, nur die lokale Struktur hat sich verändert. Die Daten landen jetzt halt nicht mehr auf dem PI, sondern auf dem NAS. Der PI sichert weiterhin in die Nextcloud und verschlüsselt ins Google Drive.

Dazu kommt dann aber noch eine weitere externe Ebene, sobald ich eine der 2TB Platten vom PI ganz abgelöst habe. Das NAS hat vorn einen USB Anschluss (hinten auch noch zwei) und man kann wohl eine Platte als externe Backupplatte einrichten. Dann kann ich die immer mal wieder anstecken, mehr Daten sichern als in die Cloud, und dann irgendwo auswärts sicher lagern. Denn wenn die Bude abfackelt nutzt das schönste RAID nichts

Schritt zurück bei der Smartwatch 4 Apr 2021 7:07 AM (4 years ago)

Nicht nur beim Smartphone bin ich weg vom Topmodell, auch bei meiner Uhr bin ich weg von der “vollwertigen” Smartwatch.

Feature-Komplett war sie ob ihres Alters eh nicht mehr, es war die letzte Generation der Andoid-Wear Uhren ohne Herzsensor und auch noch ohne NFC. Davon abgesehen funktioniert sie wunderbar, ihr für mich fast wichtigste Eigenschaft war eh, dass sie wie eine Uhr aussieht und nicht wie ein Monitor am Handgelenk.

Da die Zeit nicht stehen bleibt und es neue Geräte gibt, die meiner Nutzung besser gerecht werden, habe ich mit eine neue smarte Uhr gekauft – die weniger kann

Aber sie ist in einem wichtigen Punkt erheblich besser und es fehlen nur Funktionen, die ich nicht genutzt habe.

Auch die “Neue” ist Smart und von Fossil, aber es ist “nur noch” eine Hybriduhr.

Hybriduhren waren ursprünglich herkömmliche Analoguhren, deren (extra) Zeiger je nach Stellung bestimmte Sachen signalisiert haben. Zeiger auf die 3 bedeutet SMS angekommen, auf der 5 eine neue E-Mail usw.. Die aktuelle Hybrid HR Generation von Fossil ist anders.

Es ist eine analoge Uhr mit normalen Zeigern. Aber der Innenbereich ist ein Display. Nicht wie bei Smartwatches ein buntes OLED, sondern ein E-Ink Display mti Graustufen – wie bei einem eBook-Reader.

Der  große Unterschied ist, dass normale Displays, egal ob LCD oder OLED, ständig ihre Anzeige aktiv anzeigen und beleuchtet werden, damit man sie erkennen kann (bei OLED sind es die Pixel selbst, die leuchten). Das kostet Strom.

große Unterschied ist, dass normale Displays, egal ob LCD oder OLED, ständig ihre Anzeige aktiv anzeigen und beleuchtet werden, damit man sie erkennen kann (bei OLED sind es die Pixel selbst, die leuchten). Das kostet Strom.

E-Ink Displays werden wie Papier nur von der Umgebung beleuchtet und sie benötigen für die Anzeige nur Strom, um etwas anderes anzuzeigen. Das Display der Fossil Hybrid HR Uhren benötigt also nur Strom, wenn die Anzeige aktualisiert wird oder man die durchaus vorhandene Beleuchtung aktiviert. Die leuchtet dann etwa für 5 Sekunden.

Der riesige Gewinn gegenüber einer normalen Smartwatch ist die Akkulaufzeit. Meine alte Smartwatch kam gerade so über einen Tag, für die Hybriduhr gibt Fossil selbst ca. 2 Wochen(!) an, ich komme in den letzten Monaten auf 10-12 Tage, also gut anderthalb Wochen.

Was sie im Vergleich nicht hat ist das farbige Display und auch keinen Touchscreen. Die Interaktionsmöglichkeiten beschränken sich auf die 3 Knöpfe. Das reicht für die Steuerung des Medienplayers am Smartphone, aber sonst für nicht viel. Eingehende Nachrichten kann man lesen, aber nicht antworten. Ich glaube, man kann einfache Standardantworten definieren, aber das nutze ich genauso wenig, wie die vollständige Antwortmöglichkeit, die meine “richtige” Smartwatch vorher bot.

Insofern verliere ich nur Funktionen, die ich vorher nicht genutzt habe (Interaktion) oder verschmerzen kann (Farbe). Aber ich gewinne erheblich an Akkulaufzeit.

Wie der Name Hybrid HR vermuten lässt, hat die Uhr auch einen optischen Pulsmesser eingebaut. Ob das für mich ein echter Gewinn ist wird sich zeigen wenn ich wieder ins Fitnessstudio darf, bisher ist es auf jeden Fall ein nettes Gimmick

Ob das für mich ein echter Gewinn ist wird sich zeigen wenn ich wieder ins Fitnessstudio darf, bisher ist es auf jeden Fall ein nettes Gimmick . Die Messung läuft im Normalfall etwa jede Minute, wenn sportliche Aktivität erkannt wird auch deutlich öfter (kontinuierlich?). Die Anzeige wird allerdings weiterhin nicht fortlaufend aktualisiert, sondern im Normalfall nur alle paar Minuten. Die Werte werden aber aufgezeichnet und können in der App und wenn Verknüpft auch in Google Fit und Apple-Dingens ausgewertet werden. Einen Bewegungs/Schrittzähler gibt es auch.

. Die Messung läuft im Normalfall etwa jede Minute, wenn sportliche Aktivität erkannt wird auch deutlich öfter (kontinuierlich?). Die Anzeige wird allerdings weiterhin nicht fortlaufend aktualisiert, sondern im Normalfall nur alle paar Minuten. Die Werte werden aber aufgezeichnet und können in der App und wenn Verknüpft auch in Google Fit und Apple-Dingens ausgewertet werden. Einen Bewegungs/Schrittzähler gibt es auch.

Sportliche Aktivitäten werden entweder automatisch erkannt und die Messung (auch Dauer) gestartet oder es wird im Display nachgefragt. Die Nachfrage finde ich recht sinnfrei, wenn ich Sport mache habe ich gerade nicht die Zeit, das auch auf der Uhr zu quittieren. Entweder automatisch starten lassen oder abschalten würde ich sagen. Aber YMMV.

Auf dem Smartphone läuft wie erwähnt eine App, die die Uhr verwaltet. Sie liest die Sensordaten aus und kann diese im Fossil-Account speichern, mit Google oder Apples Gesundheitsdiensten syncronisieren und man kann sie sich in Werten und Graphen ansehen. Ein Schlaftracking gibt es auch, durch die lange Akkulaufzeit und das geringe Gewicht ist das auch tatsächlich nutzbar.

Über die App gibt es außerdem Benachrichtigungen vom Smartphone aufs Display. Die Zeiger bewegen sich dann auf die Stellung “viertel vor drei”, also waagerecht. Über den Zeigern erscheinen das Icon und den Namen der App, darunter die eigentliche Nachricht. Über die Knöpfe kann man sie auch scrollen.

Die Zeiger bewegen sich dann auf die Stellung “viertel vor drei”, also waagerecht. Über den Zeigern erscheinen das Icon und den Namen der App, darunter die eigentliche Nachricht. Über die Knöpfe kann man sie auch scrollen.

Von welchen Apps man Benachrichtigungen erhält kann man auswählen. Als die Uhr vorgestellt wurde ging das nur von einer Handvoll vorgesehener Apps, seit einem Jahr aber von allen. Im Netz findet man aber noch viele Tests aus der ersten Zeit in denen das als Einschränkung (zu Recht) kritisiert wird. Das ist aber schon mit dem ersten Update korrigiert worden.

Ebenso kann man mit der App kreativ werden und das Design der Uhr fast beliebig anpassen. Der Hintergrund und bis zu vier Komplikationen (Anzeigen) kann man frei platzieren. Über Tricks sind auch 6 Komplikationen möglich. Ich lasse mir meine Schritte, den Puls, das aktuelle Wetter und das Datum anzeigen. Bei meinem aktuellen Design habe ich nur drei Anzeigen, da hab ich das Datum weggelassen. Da die Zeiger zwangläufig regelmässig über den Anzeigen sind kann man als nettes Gimmick das Handgelenk zweimal drehen, als wenn man auf die Uhr gucken will. Dann fahren die Zeiger einmal im Kreis und man kann sich verdeckte Anzeigen ansehen. Das sieht wirklich cool aus

Die Designs kann man seit dem letzten Update auch per Link teilen, dazu empfehle ich einen Blick in die Reddit-Gruppe. Es gibt natürlich auch ein paar Standarddesigns, die haben noch ein paar mehr Möglichkeiten. Die werden mit einem der nächsten (recht regelmässigen) Updates hoffentlich auch für Alle freigeschaltet.

Die Designs kann man seit dem letzten Update auch per Link teilen, dazu empfehle ich einen Blick in die Reddit-Gruppe. Es gibt natürlich auch ein paar Standarddesigns, die haben noch ein paar mehr Möglichkeiten. Die werden mit einem der nächsten (recht regelmässigen) Updates hoffentlich auch für Alle freigeschaltet.

In der erwähnten Reddit-Gruppe gibt es auch eine modifizierte Version der offiziellen App mit ein paar kleinen Verbesserungen. So zeigt sie bei Benachrichtigungen das korrekte Icon für alle Apps an und nicht nur für ein paar fest hinterlegte. Die Synchronisation mit der Uhr erfolg auch bei jedem entsperren und nicht nur beim öffnen der App. Ein Limit für die Anzahl der Designs wurde entfernt und allgemein viele Kleinigkeiten.

Übrigens lesen auch die Entwickler von Fossil bei Reddit mit, auch wenn sie nicht offiziell antworten (dürfen) werden alle Wünsche und Anmerkungen gelesen.

Zum Abschluss ein Schritt zurück und ein Blick aufs Äußere:

Die Uhr ist etwas kleiner und leichter, als meine alte Smartwatch. Ich spüre sie kaum, was sehr angenehm ist. Und sie ist absolut unauffällig. Wer nicht genau hinsieht wird nicht erahnen, dass es mehr sein könnte als eine normale Uhr. Es sei denn, man bekommt gerade eine Nachricht und die Zeiger führen ihr Ballet auf und man sieht die Änderung des Displays und damit überhaupt erst, dass es Display ist.

Zum ändern des Aussehens kann man wie erwähnt den Innenbereich der Uhr anpassen, aber auch die Armbänder lassen sich einfach tauschen. Es sind Standardarmbänder mit 22mm breite, die gibt es an jeder Ecke sehr günstig. Für das helles Displaydesign im Bild finde ich mein Lederarmband am passensten, für die meisten anderen nehme ich das schwarz-graue “James Bond” Armband oder das ‘Milanese’ Mesh. Daneben habe ich noch ein graues Lederarmband und Sportarmbänder mit verschiedenen Farbakzenten. Nur das originale Kunststoffarmband verwende ich so gut wie nie, ist einfach nicht mein Geschmack. Aber es gibt diese Art Armbänder auch reichlich nachzukaufen, von daher ist das wirklich Geschmackssache.

Zum ändern des Aussehens kann man wie erwähnt den Innenbereich der Uhr anpassen, aber auch die Armbänder lassen sich einfach tauschen. Es sind Standardarmbänder mit 22mm breite, die gibt es an jeder Ecke sehr günstig. Für das helles Displaydesign im Bild finde ich mein Lederarmband am passensten, für die meisten anderen nehme ich das schwarz-graue “James Bond” Armband oder das ‘Milanese’ Mesh. Daneben habe ich noch ein graues Lederarmband und Sportarmbänder mit verschiedenen Farbakzenten. Nur das originale Kunststoffarmband verwende ich so gut wie nie, ist einfach nicht mein Geschmack. Aber es gibt diese Art Armbänder auch reichlich nachzukaufen, von daher ist das wirklich Geschmackssache.

Es gibt die Uhr in diversen Modellen, neuerdings auch von der Tochtermarke Skagen. Ich habe mich, trotzdem ich wusste, dass mir das Amrband wahrscheinlich nicht gefällt, für die Collider HR entschieden, weil die eigentliche Uhr sehr schlicht schwarz ist. Dadurch passen für mein Empfinden mehr Armbänder, als z.B. ein optisch schweres Metallgehäuse. Aber auch das ist Geschmackssache, Fossil ist nicht zuletzt eine Modemarke.

Wer wie ich hauptsächlich die Benachrichtigungen am Handgelenk haben will sollte sich die Fossil Hybrid Uhren mal näher ansehen.

Das neue Rowigotchi: Google Pixel 4a 27 Nov 2020 9:34 AM (4 years ago)

Gestern habe ich meine Entscheidungsfindung für das neue Smartphone gebloggt, heute soll es nun über das Gerät selbst gehen: Ein Google Pixel 4a. Mittelklasse, relativ klein, Kunststoffgehäuse – so ziemlich das Gegenteil von meinem vorherigen Huawei Mate 10 Pro. Und für mich genau richtig.

Der erste Eindruck im Vergleich ist deutlich: klein! leicht!

![]()

Ersteres ist relativ. Die Zahlen sind deutlich: 154.2 × 74.5 × 7.9 mm für das Mate 10 Pro, 144 × 69.4 × 8.2 mm für das Pixel 4a. Gut 1cm kürzer, ein halber cm schmaler, etwas dicker. Auf dem Bild oben sieht man, dass das Pixel 4a in etwa so groß ist wie das Display das Mate 10 Pro (real etwa 2mm länger). Für das sichere einhändige Halten ist vor allem die Breite relevant, das sind also “nur” 5mm, aber das reicht. Will ich einhändig mit dem Daumen die entfernteste Ecke erreichen kann ich das Gerät problemlos leicht kippen und so alles erreichen.

Da beide Displays etwa gleich hoch sind ist der Unterschied in der Höhe nur in den Rändern der Geräte. Die hat das Pixel 4a auch noch, aber sie sind schmal. Da sie vorhanden sind, ist das Display plan und nicht über die Kanten gebogen. Letzteres sieht vielleicht schick aus, ist aber unpraktisch, wie ich am S10 Plus meiner Freundin erleben darf. Würde ich nicht haben wollen (sie auch nicht mehr).![]()

Die Größe wird sehr relativ, wenn du auf das Bild rechts blickst. Da liegt das Pixel 4a auf dem Mate 10 Pro (beide in durchsichtigen Schutzhüllen) und man kann sehen, wie wenig es wirklich ausmacht. Aber das Wenige reicht, dass es sich für mich einhändig bedienen lässt. Ungewohnt ist es Anfangs dennoch.

Das Gewicht ist sachlich korrekt, von 178g auf 143g sind knapp 20% weniger und schon fast auf vor-Smartphone-Niveau. In Kombination mit den etwas kleineren Abmessungen ist der Unterschied sehr deutlich. Die ersten Stunden fühlt sich das Pixel fast wie ein Spielzeug an. Hat man sich dran gwöhnt hat man beim Mate das Gefühl, einen Ziegelstein in die Hand zu nehmen.

Schwere empfindet man oft als Wertigkeit, das will sich bei mir aber nicht mehr einstellen. Weder beim Mate 10 Pro, noch beim Galaxy S10 Plus meiner Freundin oder dem iPhone 7 Plus das ich hier auch noch habe. Sie fühlen sich im Vergleich zum Pixel 4a nur klobig an.

Nach dem ersten Eindruck geht es zu den weiteren Hardwareeigenschaften und dem Wichtigsten: die Software.

Hardware

Die weiteren technischen Daten sind wohl bekannt, ich werde sie daher nur kurz anreissen.

Typische Mittelklassehardware: Snapdragon 730G CPU, 6GB RAM, 128GB Speicher (nicht erweiterbar). Kein Wireless Charging, aber natürlich NFC. 5,81 Zoll Display über die gesamte Vorderseite ohne Notch, dafür Punch-Hole Frontkamera.

Die Hauptkamera ist wie beim Pixel 2, 3 und 3a der gleiche Sony IMX363 12,2MP Sensor mit f1.7 und optischer und elektronischer Bildstabilisation. Das wirkt sehr aus der Zeit gefallen, dass das kein Nachteil sein muss siehst du unten.

Das Gehäuse besteht komplett aus Kunststoff. Das macht es leicht und im Vergleich zu Glasoberflächen weniger rutschig und anfällig. Es ist natürlich auch günstiger in der Produktion und es kommt kein Premium-feeling auf. Billig wirkt es aber auch nicht, eher pragmatisch genau Richtig.

Bei der Farbe hält es Google genau wie Henry Ford: du kannst jede Farbe haben, solange sie schwarz ist. Ganz neu gibt es eine hellblaue Sonderedition, aber wohl auch wegen der Corona-bedingten Verzögerung hat Google ansonsten die SKUs (stock keeping units) auf 1 reduziert: 128GB in Schwarz.

Ich habe mein Pixel 4a aber mit einem Skin von dbrand individualisiert:

|

Das ist eine 3M Folie in der Farbe “Pastel Schwarz” im Precision Fit der auch die Seite umschließt. Es gibt auch noch einen Standard Fit, das ist dann nur die Rückseite. Bei dbrand sind immer beide Varianten in der Packung und ich habe erstmal den etwas schwerer anzubringenden Precision Fit probiert und es hat auf Anhieb funktioniert. Nur bei den Ecken muss ich nochmal nacharbeiten, aber das ist Kleinkram. Das Material ist optisch sehr fein, aber fühlt sich griffiger an, als die nackte Oberfläche des Telefons – und die ist schon gut im Vergleich zu den meißten anderne Geräten.

Die Folien von dbrand kann ich wirklich empfehlen, Nachteil ist allerdings der Versand aus Canada, das hat bei mir fast 4 Wochen gedauert trotz der angeblich schnelleren Lieferung mit DHL. Auch das Tracking taugt nichts. Davon abgesehen aber

![]()

Ansonsten verwende ich das Gerät wirklich nackt, zum Transport nutze ich eine rustikale Einsteckhülle von Feuerwear, Mitch 6 passt perfekt.

Software

Das Android ist so pur, wie es nur sein kann. D.h. fast, es gibt für die Pixel Geräte ein paar Goodies die andere Hersteller nicht bekommen. Die Google Kamera ist eines davon, die SmartHome Steuerung hinter dem Power-Button ein Anderes.

Im Vergleich zu allen anderen Geräten, die ich in den letzten 11 Jahren hatte, ist das System so wirklich am stimmigsten. Dass Hardware und Software aus einer Hand kommen ist spürbar, trotz der auf Papier eher mittelprächtigen Hardware läuft alles flüssig. Nur bei einigen Effekten der Kamera muss man einen Moment warten. Das beeinträchtigt aber nicht die Aufnahmegeschwindigkeit, sondern nur die Anzeige.

Das Android wird auch von Google mit Updates versorgt. Erschienen ist es in den USA im August noch mit Android 10, mein Gerät hatte aber schon Android 11 installiert. Nächstes Jahr kommt Android 12 und ich vermute es wird auch noch Android 13 bekommen.

Monatliche Sicherheitsupdates kommen jeweils Abends am ersten Montag des Monats. Das Pixel 4a ist mein erstes Gerät, das die Updates so einspielt, wie Google es mit Android 8(?) grundsätzlich eingeführt hat, aber wohl von keinem Hersteller genutzt wird: Das Gerät hat zwei Betriebssystembereiche. Das Update wird heruntergeladen und auf dem inaktiven Bereich installiert. Im Hintergrund, man merkt davon nichts. Auch das optimieren der Programme, das sonst beim ersten Start efolgt, wird schon gemacht. Um das Update zu aktivieren muss man nur einmal neu starten und das fertig installierte neue System startet. Das dauert nicht länger, als jeder andere Start.

Zur Erinnerung nochmal meine Kriterien:

- gute Kamera

glaubwürdige Aussicht auf längere Updates (oder Custom-ROM Support)

glaubwürdige Aussicht auf längere Updates (oder Custom-ROM Support) möglichst sauberes Android

möglichst sauberes Android etwas kleiner

etwas kleiner wenn möglich Mittelklasse, ich will keine 1000€ für ein Topmodell ausgeben, dafür sind auch andere Kompromisse möglich

wenn möglich Mittelklasse, ich will keine 1000€ für ein Topmodell ausgeben, dafür sind auch andere Kompromisse möglich

Ein Mittelklassegerät für 340,20€. Etwas kleiner, so dass es gut mit einer Hand zu bedienen ist und ein sauberes Android mit zuverlässigen Updates. Es fehlt also nur noch mein erster Punkt:

Kamera

Das Kamerasetup ist wie erwähnt sehr koventionell, um nicht zu sagen: alt. Diese Kobination gab es schon im Pixel 2, 3 und 3a.

Selbst Mittelklassegeräte haben heute schon oft mehrere Kameras, Google setzt weiterhin auf nur Eine. Und auf seine Software.

Warum die Software so viel erreichen kann:

Das Bild, das wir als Ergebnis bekommen, ist bei allen Digitalkameras immer nur eine Interpration der Rohdaten des Sensors. Wenn man das Motiv kennt ist es einfacher, die Daten passend zu interpretieren. Und die Google Kamera ist sehr gut darin, das Motiv zu erkennen und die rohen Sensorwerte gut zu interpretiere.

Den Unterschied kann man selbst sehen, wenn man seine Kamera auf Speicherung der Rohdaten einstellt. Das geht bei vielen oder den meisten Geräten. Auf meinem alten Huawei Mate 10 Pro war die Kamera nicht sehr gut darin, das Bild zu erkennen und hat immer recht pauschale Werte genommen. Nur bei Haut neigte sie zum weichzeichnen, das ist in Asien wohl ein beliebter Look. Unser Kater bzw. sein Fell wurde für mich da zum Benchmark, die Huawei Software hat spätestens mit ihrer starken Komprimierung das Fell verkleistert. So sehr, dass ich darüber einen eigenen Beitrag geschrieben habe. Was man mit der manuellen Interpretation der Bilder herausholen kann habe ich beim Mate 10 Pro regelmässig gesehen, meine Interpretationen waren idR. natürlicher und nicht zuletzt weil ich die Bilder nicht so sehr komprimiert habe auch feiner. Die Kamerahardware könnte es also, es ist die Software, die nicht optimal arbeitet.

Die Google Software ist wie gesagt sehr gut darin, aus den Rohdaten das Motiv zu erkennen und passend zu interpretieren. Eine Katze wird anders behandelt, als eine Landschaft und in einer Landschaft der Himmel anders als die Berge. Mit dem Fell unseres Katers hat die Kamera übrigens überhaupt keine Probleme. Ich könnte auch hier die Speicherung der Sensorrohdaten (RAW) aktivieren, aber hab bisher noch nie dran gedacht. Die Bilder sind schon so gut, dass ich sie nicht verbessern wollen würde.

Dadurch gelingt es der Google Kamera das Objekt im Vordergrund zu erkennen und z.B. im Portraitmodus einen Bokeh Effekt hinzuzufügen und den Hintergrund verschwimmen zu lassen. Ganz ohne zweite Kamera oder Tiefensensor. Und da das Objekt im Vordergrund für die Berechnung ja eh schon freigestellt wurde, kann man auch noch andere Effekte gezielt auf z.B. den Hintergrund anwenden. Das geht übrigens auch nachträglich:

|

|

Die Interpretation des gemachten Bildes fängt schon lange an, bevor das Bild wirklich gemacht wird. In dem Moment, indem man die Kamera-App öffnet, fängt sie an Fotos aufzunehmen. Eine endlose Reihe von Bilder in einem Ringspeicher, der immer wieder überschriebenn wird. Wenn man dann auf den Auslöser drückt wurde das Foto schon aufgenommen. Es gibt keine Verzögerung vom Entschluss im Kopf, über die Fingerbewegung und Reaktionszeit in der Kamera. Das Bild wurde ja schon aufgenommen, als man sich bewusst wurde, dass man es haben will. Und die Millisekunden davor und danach genauso. Die Kamera nimmt je nach Motiv auch noch die 9-15 Bilder um diesen Moment und kombiniert sie zu einem Bild.

Das alles geschieht schon, bevor es daran geht, die Rohdaten des Sensors zu interpretieren. Das Bild des Sensors wird auch schon für diese Endlosaufnahmen ausgewertet, so wird z.B. bei Tieren oder Kindern die Verschlusszeit verringert, um plötzliche Bewegungen einfangen zu können. Um dennoch genug oder mehr Licht zu haben werden wiederum mehrere Aufnahmen kombiniert. Das macht die Software vor allem auch beim Nachtmodus und dessen Steigerung, dem Astromodus für Sternenfotografie.

Auch im Nachtmodus verwendet die Software mehrere Aufnahmen und kombiniert diese. Jede einzelne Aufnahme ist dabei etwas länger, aber kurz genug, damit man das Bild nicht verwackelt. In Summe hat die Software dann doch genug Lichtinformationen vom Sensor für ein schönes Bild.

Auch hier kommt die Motiverkennung zur Entfaltung: unterschiedliche Bildbereiche werden auch unterschiedlich behandelt. Eine lange (Reihen-) Belichtung lässt auch eine dunkle Szene heller erscheinen, aber es wirkt dann leicht unnatürlich. Das berücksichtigt die Software und behandelt z.B. den Himmel anders, als den Vordergrund. Die “Magie” hinter dem Nachtmodus hat Google hier gebloggt und auch auf Konferenzen vorgetragen.

Was das praktisch bedeutet konnte ich vor ein paar Wochen Nachts spontan ausprobieren. Unser Kater lag in einer sehr hellen Nacht am Fenster und beobachtete die Straße. Das habe ich mit den drei Smartphones die ich liegen hatte fotografiert. Alle mit ähnlicher Hardware was Alter und Konfiguration angeht: ein iPhone 7 Plus (Ende 2016), ein Huawei Mate 10 Pro (Ende 2017, den SW Sensor können wir wohl ignorieren) und das Pixel 4a, das zwar neu ist aber eine Hardware hat, die schon seit dem Pixel 2 von Ende 2017 so eingesetzt wird:

Das iPhone hat keinen dedizierten Nachtmodus und generell fast keine manuellen Kontrollen. Die Software sorgt aber auch hier für die guten Ergebnisse, für die das iPhone bekannt ist.

Mit dieser Szene hat die Software aber ihre Probleme. Belichtet für 1/4 Sekunde bei ISO800 erkennt man zumindest den Himmel, der Rest ist aber eher schwarz:

Das Mate 10 Pro schlägt sich besser. Ich habe den Nachtmodus aktiviert und es ansonsten auf Automatik gelasssen. Es hat die Szene mit 1/2 Sekunde doppelt so lange belichtet und ist auf ISO1000 gegangen.

Das Ergebnis ist ein deutlicherer Himmel mit den Wolken und man erkennt die Silhuetten der Häuser:

Das Pixel hat den Nachtmodus direkt vorgeschlagen (das Pixel 4a 5G und Pixel 5 können ihn auch automatisch aktivieren), das habe ich auch getan. Der Rest blieb wieder auf Automatik. Auch das Pixel hat nominell 1/2 Sekunde belichtet, ist aber auf recht hohe ISO6240 gegangen. Nominell deshalb, weil es mehrere Aufnahmen (4 oder 5) gemacht und diese kombiniert hat zu einem Bild. Das Resultat ist ein klar erkennbarer Himmel und Wolken und die Häuser sind nicht nur Silhuetten, sondern die Dächer sind bis auf einzelne Dachpfannen genau aufgenommen. Wer zählt sie nach? Und man erkennt erstmals sogar den Kater:

Die Nacht war real in etwa so hell wie auf dem Bild des Pixels. Das hat es wirklich gut eingefangen. Nur den Kater konnte man als Mensch natürlich viel genauer erkennen.

Die Szene ist fies, aber zeigt gut, was Software zu leisten in der Lage ist und dass Software den Unterschied macht.

Auf die Spitze getrieben hat Google den Nachtmodus mit der Astrophotografie:

Denkt man die Mechanismen des Nachtmodus etwas weiter landet man am Himmel. Um Sterne aufzunehmen braucht man Licht. Sehr viel mehr Licht, als nur am Abend. Aber da geht doch was!

So in etwa haben die Leute bei Google wohl gedacht und die Astrophotografie entwickelt (und hier ausführlich beschrieben). Lange belichten allein reicht da nicht, wenn man mehrere Minuten belichtet sieht man die Bewegung der Sterne am Himmel. Es wären also keine Punkte, sondern Striche. Die Google Kamera des Pixel nimmt dadurch bis zu 15 Bilder zu je maximal 16 Sekunden auf und kombiniert diese zu einem Bild. Es ginge auch mehr, aber so kommt man auf 4 Minuten Aufnahmezeit und mehr will wohl niemand warten. Also limitiert die Software es auf diese 4 Minuten.

Vorraussetzung dafür ist neben Dunkelheit, dass das Telefon still steht oder liegt, man es also nicht in der Hand hält. Im Nachtmodus aktiviert sich der Astromodus (nur) automatisch, wenn es Dunkel genug ist und das Telefon auf einem Stativ oder ähnlich fest steht. Ich habe mir dieses Stativ gekauft und kann es für Smartphones empfehlen.

Die Ergebnisse sind wirklich beeindruckend:

|

Der Sternenhimmel allein ist übrigens sehr langweilig auf so einem Bild, hier machen die Wolken es erst richtig interessant.

Mit Objekten im Vordergrund wird es noch beeindruckender, hier unser Dorfkrug mit Bäumen. Man erkennt das Gebäude (die Beleuchtung unten kommt nur von den Notausgangsschildern!) und den Sternenhimmel darüber. Dahinter liegt Flensburg, daher ist der Himmel nie wirklich dunkel:

Um die Sterne wirklich zu sehen musst du einmal draufklicken für das Originalbild.

Um die Sterne wirklich zu sehen musst du einmal draufklicken für das Originalbild.

Und ich habe mich auch schon an künstlerischer Verwendung des Astromodus gemacht, dieses Bild nenne ich “Der Garten schläft”:

Fazit

Wie man unschwer herauslesen kann bin ich sehr angetan vom Pixel 4a. Für meine Bedürfnisse wäre es Verschwendung, mehr Geld auszugeben.

Das Telefon liegt gut in der Hand, macht tolle Fotos und bekommt pünktlich seine Updates. Bei der Mittelklasse können mit Topmodelle gestohlen bleiben

Neues Rowigotchi: Meine Smartphone Entscheidungsfindung 26 Nov 2020 2:13 AM (4 years ago)

Es war mal wieder Zeit für ein neues Smartphone. Eigentlich hatte ich schon Ende letzten Jahres einen mehr als oberflächlichen Blick auf das Nokia 7.2 geworfen. Zurück zur Mittelklasse, vielversprechende Kamerahardware.

Zu dem Zeitpunkt war unser halber Hausstand aber noch im Container, darunter so ziemlich alles Zubehör für mein Huawei Mate 10 Pro. Da das dann zu eBay gehen sollte und das Mate 10 Pro ja noch gut funktioniert (bis heute) habe ich ein neues Telefon bis zu unserem Rückzug zurückgestellt.

Im Januar war es dann nicht mehr lang zum MWC (Mobile World Congress), an dem traditionell viele neue Geräte vorgesellt werden. Und da ich das letztes Jahr vorgestellte Google Pixel 3a sehr interessant fand, war ich auch auf das für Mai avisierte Pixel 4a sehr gespannt. Ein Gerät mit etwas modernerem Design war meine Hoffnung. Also habe ich die Entscheidung auf etwa Mai verschoben.

Und dann kam Covid19 und hat die Welt durcheinander gebracht.

Der Mobile World Congress fiel aus, mit ihm auch fast alle Gerätevorstellungend. Google hat seinen IO Kongress verschoben, virtualisiert und schließlich abgesagt. Keine Gerätevorstellung, obwohl die bis dahin lancierten Eckdaten das Gerät sehr interessant erschienen liess.

Also habe ich meine Entscheidung weiter verschoben, das Mate 10 Pro war und ist ja nicht langsam, es war irgendwie nur nicht mehr das richtige Gerät für mich. Da wollte ich die Entscheidung für ein neues Gerät nicht übers Knie brechen. Also habe ich gewartet. Und beobachtet.

Sowohl den Coronabedingt schwachen Markt, als auch mich. Was will ich wirklich? Vor über 2 Jahren war mein Grund, meine Grundsätze über Bord zu werfen und zu ändern die Kamera des Huawei Mate 10 Pro, das sich meine Freundin gerade gekauft hatte. Vor allem von den Bilder bei schwacher Beleuchtung war ich begeistert.

Mit der Zeit haben sich aber andere Defizite herauskristallisiert, die mich immer mehr störten. Die Kamera ist gut, die Software neigt aber zum starken komprimieren. Vor allem das Fell unseres Katers wurde da für mich zum Massstab. Das wurde mit jedem großen Update (Android 8→9→10) merklich besser, aber ich habe mir wichtige Bilder immer auch als RAW fotografiert. Damit konnte ich praktisch immer tolle Bilder machen, die Hardware ist weiterhin gut.

Ich habe immer das “reine” Android bevorzugt, seit ich vor 11 Jahren bei Version 1.5 in die Android-Welt eingestiegen bin. Huaweis EMUI Oberfläche war wie erwartet nicht nach meinem Geschmack, mit ein paar Workarounds ging es aber. Ich nutze eh einen alternativen Launcher und halte mich selten in den Systemeinstellungen auf. Ein neues Gertät sollte da nach Möglichkeit aber “sauber” sein.

Updates sind mir auch wichtig. Ich war es vom ersten Gerät (Samsungs erstes Android überhaupt) gewohnt, dass die Hersteller die Geräte nach dem Verkauf ignorieren. CyanogenMOD/LineageOS hab ich in den ersten Jahren immer installiert. Die Geräte blieben so auf aktuellem Stand und wurden in der Regel auch deutlich schneller. Huawei hat mich hier extrem enttäuscht, das Mate 10 Pro war “Enterprise recommended” und hätte dadurch 2 Jahre lang neue Android-Versionen und 3 Jahre lang die monatlichen Sicherheitsupdated bekommen müssen. Das hat Huawei nie wirklich interessiert, die 90 Tage Frist um ein monatliches Updates herauszubringen wurden Anfangs maximal ausgereizt und später ignoriert. Nach Trumps Feldzug gegen Huawei sowieso, aber auch schon davor.

Der nächste Punkt war die Größe. Das 6” Display ist wirklich schön zu benutzen, aber für mich nicht mehr einhändig zu bedienen. Zwei Hände zu benutzen ist nicht das Problem, mache ich eh meistens, es aber auch machen zu müssen nervt aber. Z.B. im Supermarkt, wenn man dafür die Einkäufe weglegen muss um mal schnell auf die Liste zu gucken.

Die Kriterien waren für mich also:

- gute Kamera

- glaubwürdige Aussicht auf längere Updates (oder Custom-ROM Support)

- möglichst sauberes Android

- etwas kleiner

- wenn möglich Mittelklasse, ich will keine 1000€ für ein Topmodell ausgeben, dafür sind auch andere Kompromisse möglich

Das machte die Wahl einfacher, gerade auch in der Corona-reduzierten Welt.

Das Pixel 4a war von den im Grunde komplett durchgesickerten Spezifikationen mein Massstab geworden, weil es komplett zu passen schien. Auch wenn es nur ein Geist war half ein Vergleich, da ich ja keinen Druck hatte. Sehr lange Zeit hatte ich aber kein Wunschgerät im Hinterkopf das ich mir kaufen würde, wenn das Mate 10 Pro plötzlich kaputt gehen würde.

Und dann wurde das Pixel 4a im August tatsächlich offiziell vorgestellt und für mich stand die Entscheidung an.

Oder auch nicht. Das Gerät war angekündigt, aber für später. Ende August in den USA, in Deutschland sollte man es erst mitte September vorbestellen können, Auslieferung im Oktober. Noch ein Vierteljahr warten?

Aber meine Vergleiche mit anderen Geräten hatten eine “reale” Basis. Was auch die Recherchen verinfachte, weil alle Welt das Pixel 4a für mich mit anderen Geräten verglich. Ich legte meine obigen Kriterien an und so viel das gehypte Oneplus Nord sofort raus. Zu groß und schlechte Kamera(software) für die ich gleich Ersatz suchen würde.

Und so wurde es immer konkreter: für mich blieb das Pixel 4a am Besten geeignet. Als man es vorbestellen konnte war zwar das Pixel 4a 5G mit etwas besserem Prozessor und 5G schon sehr konkret, aber für mich zu groß und auf 5G kann ich wohl noch 2 Jahre verzichten.

Und so habe ich das Pixel 4a im September vorbestellt und Anfang Oktober auch bekommen. Und da ich nach meiner langen Blogauszeit viel mehr geschrieben habe, als ursprünglich gedacht, werde ich konkret über das Pixel 4a einen eigenen Beitrag schreiben.

Danke, dass du mein Geschwafel bis hierhin ertragen hast und ich verspreche, dass ich den konkreten Beitrag zum Pixel 4a spätestens morgen online stelle .

.

Wenn jemand eine Reise tut, so kann er was erzählen... (oder: Kommunikationsversagen bei der Bahn) 31 Jul 2020 6:13 AM (4 years ago)

Nach langer Zeit bin ich am Dienstag mal wieder Bahn gefahren. Für die Firma sollte es von Flensburg nach Leipzig gehen. Mit dem Regionalexpress nach Hamburg und von dort weiter mit dem ICE über Berlin nach Leipzig.

Reisen mit der Bahn verbinde ich mit Chaos und Verspätung. Und Beides trat ein. Noch bevor der Zug auch nur einen Millimeter gefahren ist.

Ich hatte die Entwicklung in der Gruppe geteilt und kopiere sie hier einfach noch einmal rein. Tippfehler und falsche Autokorrekturen hab ich so gelassen:

12:26

Seit Ewigkeiten sitze ich mal wieder im Zug. Wie sollen nach Leipzig in Hamburg 7 Minuten Zeit umzusteigen. Unser Zug steht noch im Bahnhof, hätte vor 11 Minuten losfahren sollen. “unsere Abfahrt verzögert sich noch einige Minuten, wir warten noch auf das Zugpersonal”

(Es kam der Tipp, schonmal einen Sitzplatz im nächsten Anschlusszug zu reservieren wenn der Zug losfährt)

12:32

Wir gucken schonmal, das Zeitfenster für den nächsten Zug ist schon zu.

12:34

Und nun fällt unser Zug offiziell aus

12:43

Nachdem wir aussteigen mussten weil der Zug ausfällt durften wir wieder einsteigen. Er fährt halt ne Stunde später um 13:15 los

12:50

Jetzt wieder raus aus dem Zug und in einen anderen 3 Gleise weiter. Hoffentlich hat der personal

12:55

Das Personal lässt uns nicht einsteigen, weil der Zug auf ein anderes Gleis umsetzen soll. Dabei sieht er für diesen Bahnsteig sogar schon auf den Anzeigen

13:05

Wir stehen noch immer vor dem Zug der in 10 Minuten abfahren soll und dürfen nicht rein. Auch das Personal hat keine Informationen

13:06

Die Helden von der Bahn werden sich diesem Zug ausfallen lassen. Ein Zug der nicht fährt ist ja nicht verspätet

13:10

Ein Mitarbeiter hat jetzt entschieden, dass wir einsteigen dürfen. Nun muss er nur noch losfahren.

13:11

Die beiden Lokführer haben widersprechende Anweisungen. Mal sehen wann die das geklärt bekommen

13:16

Die Abfahrt 13:15 haben wir schonmal verpasst…

13:17

Wir fahren! Nun mal abwarten welchen Zug wir in Hamburg erwischen

(es kam eine Frage nach 2 Lokführern)

13:23

Einer für den 13:15 und der vom 12:15 Einer hatte die Information, dass der Ausgefallene abgekoppelt und mit nach Hamburg soll

14:36

Bis Neumünster haben wir es geschafft, nun diskutiert das Personal wieder. Offenbar gibt es Probleme den Zug aus Kiel anzukuppeln. Er schien sich bei der Durchdachte aber wohl nicht so ganz sicher zu sein, was er sagen soll

Nachdem das Kupplungsproblem gelöst war verlief die weitere Fahrt problemlos. Mit IIRC 17 Minuten (+1 Stunde) Verspätung haben wir Hamburg Altona erreicht und mit etwa eine Dreiviertelstunde Puffer haben wir dann auch den ICE erreicht, der 2 Stunden nach dem eigentlich geplanten fährt.

Auch ohne gültige Reservierung hatten wir sogar einen Platz mit Tisch, wenn auch kein eigenes Abteil. Und um 19:42 erreichten wir Leipzig, so dass ich den Reisebericht abschliessen konnte:

20:05

In Leipzig angekommen und eingecheckt. Jetzt Futtern

Natürlich lag das Problem komplett in Flensburg bzw. an der DB Regio Schleswig-Holstein. Und das war ein Versagen auf mehreren Ebenen.

Zu dem Problem mit dem Personal oder dessen Planung kam dann ein Totalversagen in der Kommunikation sowohl mit den Angestellten der Bahn, als auch den Fahrgästen.

Es ist schon ein Unding, dass die Fahrgäste erst gut 10 Minuten nach der geplanten Abfahrt überhaupt das erste Mal informiert werden, dass es ein Problem gibt.

Und dann wurde das vorhandene Personal offenbar genauso schlecht und widersprüchlich informiert. Niemand wusste etwas, alle Reisenden wurden aus dem Zug geschickt, wieder rein geschickt, dann raus in einen anderen Zug, der einen dann nicht einsteigen lässt.

Die Disposition der Züge ist in so einer Situation sicherlich nicht einfach. Der 12:15 Zug ist ja nicht nur nicht-abgefahren, er ist dann in 2 Stunden auch nicht in Hamburg und kann wieder abfahren. Das kann sich bis zum nächsten Morgen ziehen, wenn man keinen Ersatzzug hat. Wenn ich bei der Deutschen Bahn (egal welche Sub- Sub Sub-Gesellschaft) raten müsste, würde ich davon ausgehen, dass die Anzahl der verfügbaren Ersatzzüge im niedrigen 0-stelligen Bereich liegt.

Aber auch wenn es schwierig ist, ist das Wichtigste die Kommunikation. Koordiniert. Das Personal muss auf dem Laufenden gehalten werden und sei es darüber, dass es noch kein Update gibt. Koordination ist hier wichtig, damit es eben nicht zu widersprüchlichen Informationen kommt. Nur wenn das Personal vor Ort zuverlässig informiert wird, kann es die Reisenden informieren.

Mein Eindruck war, dass die weitere Planung der Züge von einem Schülerpraktikanten gemacht wurde und dass jeder in der Leitstelle seine Meinung den Leuten vor Ort mitgeteilt hat.

Von außen betrachtet war die Leitstelle mit dieser Situation völlig überfordert. Dabei sind Zugausfälle gefühlt doch eher die Regel, als die Ausnahme.

Die Mitarbeiter der Leitstelle sehen das sicherlich anders, aber es war auf jeden Fall ein Totalversagen in der Kommunikation mit den Kunden. Die für eine Leistung im voraus bezahlt haben und um ihre Anschlusszüge bangen müssen. Und die Vorraussetzung für eine ordentliche Kundenkommunikation ist, dass das Personal vor Ort vernünftig informiert wird. Und das ist offensichtlich nicht geschehen.

Als Kunde ist man dann aufgeschmissen. Es gab auch überhaupt keine Information über die Fahrgastrechte. Was ist mit Anschlüssen? Reservierungen? Was, wenn ich dadurch den dritten Anschluss nicht bekomme und “irgendwo” übernachten muss?

Nein, liebe Bahn. Und wirklich “die Bahn”, der Fisch fängt vom Kopf an zu stinken. Die Kommunikation war eine 6- für ein offensichtliches Chaos nach einer Störung im Betriebsablauf den ihr schlicht beherrschen können müsst.

Und auch wenn das tatsächlich ein ganz speziell besonderer Zugausfall gewesen sein sollte: Informiert eure Kunden und vor allem das Personal! Und zwar koordiniert über nur eine Person die einen Überblick hat.

Barcamp digital 15 Jul 2020 8:06 AM (4 years ago)

Update: Leider war die Teilnahme zu gering (auch ich habe nichts eingereicht) und daher wurde das DiBaSH abgesagt

Corona-bedingt müssen fast alle Veranstaltungen derzeit ausfallen, darunter natürlich auch Barcamps. Hier oben hat es im März das Barcamp Flensburg erwischt und auch das Barcamp Kiel wird nächsten Monat nicht stattfinden.

Als Alternative haben die Barcamps aus Kiel, Lübeck, St. Peter-Ording und Flensburg als Alternative das Digitale BarCamp Schleswig-Holstein erarbeitet.

Das Event findet in drei Etappen statt:

- bis zum 24. Juli können Sessions eingereicht werden

- am 31. Juli abends wird wie vor jedem Barcamp (online) über die Sessions abgestimmt

- am 1. August werden online die Sessions abgehalten

Die Details gibt es auf der Webseite (noch ohne “hübschen” URL) und dort trägst Du dich am Besten in die Mailingliste ein. Auch das Formular zum einreichen der Sessions gibt es dort.

Barcamp T-Shirts (und eine Tasse) gibt es zum Selbstkostenpreis bei Seedshirt.

Barcamp T-Shirts (und eine Tasse) gibt es zum Selbstkostenpreis bei Seedshirt.

Ich werde auf jeden Fall dabei sein! Für eine Session habe ich momentan keine Idee, aber da habe ich ja noch bis Ende nächster Woche Zeit mir etwas auszudenken. Hast DU eine Idee?

Raspberry Pi (4) und die Temperatur 26 May 2020 7:05 AM (4 years ago)

Mittlerweile habe ich ein paar Raspberry PI hier im Einsatz, darunter auch einen aktuellen Raspberry PI 4. Mit 4GB RAM taugt der durchaus für kleinere Desktoparbeiten.

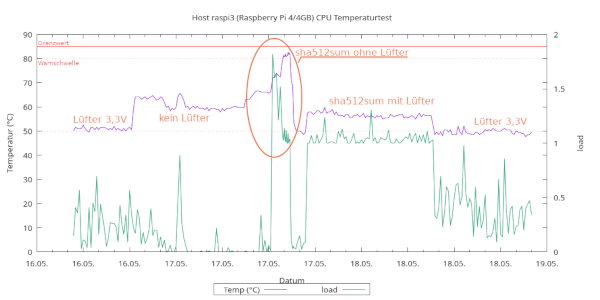

Praktisch überall zu lesen ist allerdings, dass der PI 4 warm wird. Sehr warm. Eine aktive Kühlung ist da praktisch Pflicht. Da passte es also ganz gut, dass die erste Gehäuse praktisch alle inklusive Kühlkörper und Lüfter verkauft wurden (das originale Gehäuse finde ich nicht so praktisch). Die Kühlung war also kein Problem. Da es ein relativ simpler und eher lauter Lüfter ist, habe ich ihn statt auf 5V auf 3,3V gesteckt. So läuft er langsamer und leise.

Irgendwann habe ich ein kleine Script geschrieben, das mir via cronjob alle 15 Minuten die Temperatur und die Systemlast in eine Datei schreibt. Und stellte fest, dass er mit gut 50°C gar nicht so richtig warm wird. Ab 80°C gibt es eine Warnung, bei 85°C takten alle PIs automatisch runter um die Temperatur zu senken.

Braucht der Raspberry PI4 wirklich eine aktive Lüftung?

Nachdem ich das auch bei Twitter gefragt hatte und die Rückmeldungen deutlich Richtung “nein” gingen habe ich ihn einfach mal abgeschaltet.

Das Ergebnis: eine um gut 10°C höhere Temperatur, so etwa 63°C. Also noch 20°C bis zur Schutzschaltung.

Wirklich viel tat er in der Zeit nicht, der PI läuft mit Manjaro Linux (64Bit), zu der Zeit lief die XFCE Oberfläche und ein Firefox mit ein paar offenen Tabs war im Speicher. Dazu nur einige Hintergrunddienste wie Syncthing oder der NFS-Server.

Daher musste ein wenig Systemlast her! Also liess ich ihn die SHA512 Prüfsumme von /dev/urandom berechnen. Das ist eine endloser Zufallszahlengenerator und sollte das kleine Ding ausreichend beschäftigen .

.

Die Temperatur stieg auch sehr schnell an die 80°C, schwankte lange Zeit zwischen 79°C und 82°C bei langsamer Steigerung. Etwa eine Stunde habe ich ihn so rechnen lassen, da lag er dann so zwischen 80°C und 83°C.

Das alles ohne aktive Lüftung, nur die Kühlkörper waren noch auf den Chips. Bei den aktuell nordisch kühlen Temperaturen käme man also ohne aktive Kühlung aus, auch bei hoher Rechenlast. Die werden Raspberry PIs aber wohl eher selten dauerhaft verrichten. Wie man an der load sieht waren aber auch nicht alle Kerne ausgelastet. Es ginge mehr…

Wenn es auch hier oben dauerhaft warm wird werde ich es noch einmal wiederholen um zu sehen, ob ein paar Grad mehr Lufttemperatur entscheidend mehr ausmachen.

Einstweilen habe ich den Lüfter wieder angeschlossen, weil er mit 3,3V betrieben nur leise surrt und halt eh im Gehäuse steckt. Bei einem weiteren PI 4 werde ich es aber wohl erstmal ohne versuchen.

Hier liegt auch noch einer auf dem Schreibtisch, aber das war wohl ein DOA. Das grüne Licht blitzt nur einmal auf beim einschalten und mehr passiert nicht. Die dokumentierten Wege um den Bootloader neu zu flashen sind wirkungslos. Mal sehen, ob ich da noch etwas erreiche.

Meine anderen Raspberry PIs, ein 1B und ein 3B, betreibe ich übrigens gänzlich ohne Kühlung. Weder Kühlkörper, noch Lüftung. Sie stecken allerdings auch in recht offenen Gehäusen, die freien Zugang zu den GPIO und sonstigen Anschlüssen erlauben. Es kann sich da also keine warme Luft aufstauen.

Anders mein PI Zero W, der steckt sogar im schlanken Originalghäuse. Aber noch ist der nicht im Dauereinsatz. Das gilt ebenso für einen weiteren PI 3B, der in einem NES-like Gehäuse steckt und am Fernseher mit RetroPie immer mal wieder für Spiele zum Einsatz kommen soll. Auch da erwarte ich keine Temperaturprobleme, werde sie aber natürlich überwachen.

Oben erwähntes Script zur Dokumentation der Temperatur habe ich auf den anderen beiden PIs auch installiert, ganz ohne Kühlung liegen sie bei ~50°C:

|

|

Wie sind DEINE Erfahrungen mit der Temperaturentwicklung beim PI?

Ich vermute, dass die frische Seeluft hier da so seine Vorteile haben könnte…

Keine Webcam? (Android) Smartphone hilft! 25 Apr 2020 4:04 AM (4 years ago)

Momentan ist der Bedarf an Webcams enorm gestiegen. Sei es für’s Home Office oder für private soziale Kontakte.

Jetzt, wo man Andere nicht besuchen kann, darf, sollte, tut es gut, einander dennoch zu sehen. Bei einem Anruf geht das bei iPhones untereinander per Facetime; mit Android oder gemischt per Google Duo – das gibt es auch für iOS.

Videotelefonie ist praktisch, aber halt immer nur zwischen zwei Personen bzw. Geräten. Natürlich kann man das auch ausweiten, aber für mehr als einen Anruf taugt das nicht. Für ein richtiges virtuelles Treffen, sei es privat oder beruflich, ist das eher nicht geeignet.

Laptops haben meist eine Webcam eingebaut, damit kann man meist ganz gut arbeiten. Wer kein entsprechendes Gerät hat oder nutzen kann/will schliesst eine Webcam an seinen PC an und hat dann nicht nur größere Monitore, sondern kann auch noch nebenbei etwas nachsehen oder gar arbeiten.

Wer nicht schon eine Webcam hat, hat da aber momentan schlechte Karten. Webcams sind entweder gar nicht mehr zu bekommen oder kosten Mondpreise mit selten seriöser Quelle. Statt 30€ werden derzeit auch mal über 200€ aufgerufen und das sind dann Anbieter, von denen ich normalerweise nicht unbedingt bestellen würde.

Die Alternative haben viele in der Hand oder in der Schublade liegen: ein Android Smartphone. Eine App und ein Programm auf dem Rechner machen das Smartphone zur Webcam. So einfach, so naheliegend.

Auf dem Smartphone installier man die App Droidcam, das stellt die Kamera(s) des Smartphones per WLAN und USB zur Verfügung. Per Browser kann man dann schon auf die Kamera zugreifen, das ist dann aber mehr eine Netzwerkkamera.

Dazu kommt dann ein kleines Programm auf dem PC, das das via WLAN oder USB (dafür muss man noch adb aus den Android Entwicklertools installieren) im Betriebssystem als normale Webcam zur Verfügung stellt. Unter Windows und Linux ist die Kamera des Smartphones dann eine normale Kamera und kann vom Browser oder Videokonferenzprogrammen ganz normal verwendet werden.

Übrigens nicht nur die Kamera, auch das Mikrofon kann so genutzt werden. Ich benutze aber lieber ein Bluetooth-Headset, die gibt es im Gegensatz zu den Webcams noch reichlich zu kaufen.

Bei mir zu Hause habe ich dafür mein altes Sony Xperia Z1 Compact aus der Versenkung geholt und per Klettband hinten an einem der beiden Monitore angebracht. Da der Akku des Gerät nahezu tot ist hängt es dauerhaft am Netzteil, das stört nicht. Durch das Klettband kann ich das Smartphone abnehmen und Droidcam starten, normalerweise bediene ich es aber vom Rechner aus mit Anydesk, das ist für die Privatnutzung kostenlos.

Am PC startet man wie gesagt nur ein kleines Programm dem man die IP-Adresse des Smartphones mit Droidcam mitteilt. Damit man die Adresse nicht jedesmal nachsehen muss sollte man dem Smartphone im Router eine feste Adresse geben.

Am PC startet man wie gesagt nur ein kleines Programm dem man die IP-Adresse des Smartphones mit Droidcam mitteilt. Damit man die Adresse nicht jedesmal nachsehen muss sollte man dem Smartphone im Router eine feste Adresse geben.

Mit dem kleinen Programm kann man ansonsten noch das Bild zoomen, den Blitz als Beleuchtung einschalten und den Autofocus starten. Aber eigentlich braucht man es nach der Verbindung nicht mehr.

Ich habe dieses Setup nun schon bei einigen virtuellen Treffen mit Freunden genutzt und es funktioniert wunderbar. Die Kamera fällt bei unseren bundeslandübergreifenden Kneipenrunden vor allem dadurch auf, dass das Bild im klassischen 4:3 Format ist, während “richtige” Webcams heutzutage 16:9 Bilder liefern. Ansonsten ist die Bildqualität vor allem vom Umgebungslicht abhängig.

Die Lösung funktioniert für mich jedenfalls so gut, dass ich es technisch mit der kostenlosen Version ausprobiert habe und für den realen Einsatz die Vollversion gekauft habe. Die kostenlose Version hat nur eine geringe Auflösung und Droidcam bot mir eine gute Lösung für mein Webcam-Problem. Das war mir dann nicht nur die 4,89€ wert, so ganz grundsätzlich hat da jemand Arbeit reingesteckt und dafür soll er auch etwas bekommen.

Corona: tolle Musikstreams für den Zeitvertreib 31 Mar 2020 7:49 AM (5 years ago)

Derzeit verbingen die Meisten (hoffentlich!) mehr Zeit zu Haus und da gibt es zwei musikalische Leckerbissen um die Zeit zu vertreiben:

United We Stream

Die Berliner Clubs sind natürlich auch alle geschlossen und bringen unter dem Motto United We Stream einen digitalen Club zu Dir nach Haus. Täglich von 19:00 bis Mitternacht gibt es Livestreams aus wechselnden Berliner Clubs und mit jeweils unterschiedlichen DJs.

Ich sehe den Stream via arte, dort sind alle Streams noch für 1 Jahr in der Mediathek aufrufbar. Heute Abend läuft die Aktion seit 14 Tagen, bei 5 Stunden pro Tag ist das schon ordentlich was auf die Ohren.

Montreux Jazz Festival

Das Montreux Jazz Festival gibt es seit 1967 und so ziemlich alles was Rang und Namen – nicht nur im Jazz – ist dort schon aufgetreten. Nun kann man über 50 Konzerte für 30 Tage kostenlos streamen, darunter Nina Simone und Ray Charles, aber auch Grönemeyer, Korn, RUN DMC oder Alice Cooper.

Die Streams laufen über Stingray/Qello, dort meldet man sich kostenlos an und löst über den Link stingray.com/FREEMJF1M den Gutscheincode FREEMJF1M ein. Anschließend kann man die Konzerte über stingray.com/MJF aufrufen und ansehen/hören.

Das Konzert von Herbert Grönemeyer war schonmal (fast ) so gut wie letztes Jahr in Flensburg. ZZ Top war auch Klasse und für RUN DMC dreh’ die Anlage ruhig richtig laut…

) so gut wie letztes Jahr in Flensburg. ZZ Top war auch Klasse und für RUN DMC dreh’ die Anlage ruhig richtig laut…

Oh Corona... 20 Mar 2020 8:01 AM (5 years ago)

siet letzte Woch’ is dat um me gescheh’n.

Nein, ich bin nicht infiziert. Zumindest nicht, dass ich wüsste. Es gibt auch keine Anzeichen oder verdächtige Kontakte.

Aber spätestens seit einer Woche kann man die Einschränkungen des öffentlichen Lebens nicht mehr ignorieren. Und das ist gut so. Jeder muss seinen Teil dazu beitragen. Und das ist grundsätzlich nicht viel: Kontakt vermeiden.

Das Virus verbreitet sich exponentiell, derzeit verdoppelt sich die Zahl der Infizierten etwa alle 3 Tage. Bei aktuell 16.290 Infizierten in Deutschland laut Dashboard der John Jopkins University bedeutet das, dass wir in einer Woche bei knapp 70.000 Infizierten sind. Eine Woche später fast 300.000. Vermutlich hab ich mich verrechnet und die Zahlen sind noch viel höher.

Vermutlich 10%-15% (wie viel genau wird man erst später feststellen können) davon müssen im Krankenhaus behandelt werden. Zusätzlich zu all jenen, die da eh schon sind oder rein kommen. Das kann kein Krankensystem leisten.

Also muss die Infektionsrate gesenkt werden, damit genug Kapazitäten zur Behandlung da sind und es hoffentlich bald eine Behandlung und später idelerweise auch eine Impfung gibt.

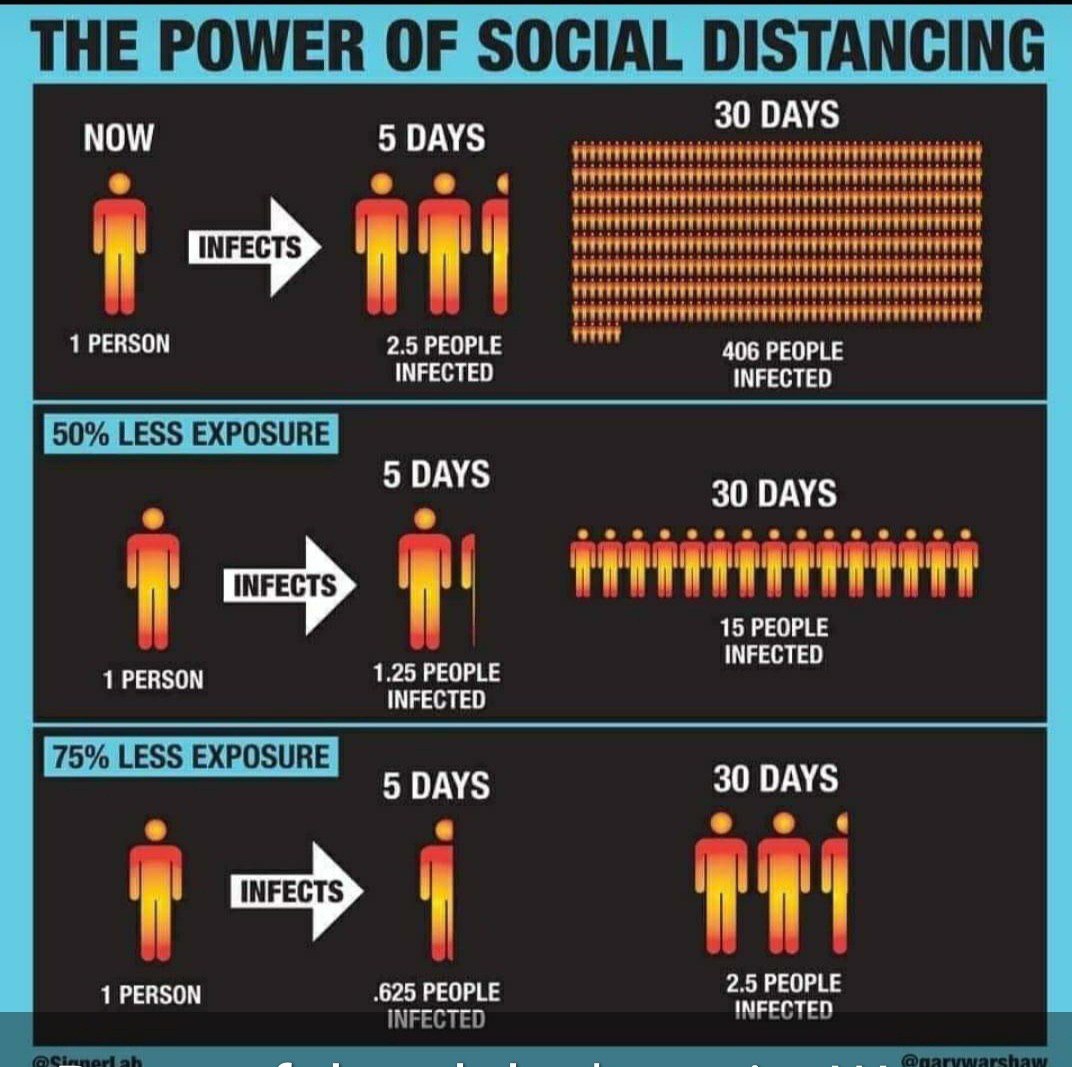

Wie viel verringerter Kontakt ausmacht sieht man in dieser Grafik, die ich aus dem Telegram-Channel von Om habe:

Der Unterschied ist gewaltig und letztlich entscheidend für die Dauer der Einschränkungen und der Krise.

Am Wochenende dürfte die Entscheidung fallen, dass es Ausgangssperren gibt. Mit bestem Dank an die Ignoranten, die so tun, als wäre alles nicht so schlimm .

.

Jeder könnte infiziert sein, auch DU (und ich). Die meisten werden nichtmal ersthaft krank, sondern haben irgendwas zwischen gar nichts und einer normalen Erklältung. Kinder werden z.B. praktisch nie krank. Aber jeder Infizierte verbreitet das Virus und steckt ohne es zu merken Andere an, die ihrerseits wieder unbewusst viele Andere anstecken. Und dieses exponentielle Wachstum muss verlangsamt werden.

Also:

- Nimm die Gefahr ernst!

- Halte Abstand! Das schützt Dich und Andere.

- Wasch Dir die Hände! Seife reicht, Desinfektionsmittel ist überflüssig. Hauptsache gründlich.

- Huste in die Armbeuge! Egal, ob es nur ein starkes Räuspern ist oder wirklich ein Hustenreiz.

Wenn wir uns jetzt eine Weile zusammenreissen bleibt es hoffentlich bei ein paar Wochen Einschränkungen und Monaten aktuem Coronabefall. Aber jeder Vollidiot der meint das beträfe ihn nicht sorgt dafür, dass es nicht besser, sondern schlimmer wird.

Mein neues Tablet und Notebook ist ein Chromebook 30 Jan 2020 9:57 PM (5 years ago)

Vorigen Sommer hatten wir ja so ein kleine Malheur mit Wasser – das bis vor 4 Wochen anhielt.

Wie fast alles, was wir nicht für die ursprünglich geplante 3-4 Wochen zurückbehalten hatten, war mein Computer für Monate in einem 20 Fuß-Container eingelagert. Ein paar Wochen geht das schon mit Smartphone und Tablet…

Aus den Wochen wurden Monate und irgendwann fragte mich mein Nachbar, als ich wiedermal seinen Rechner brauchte, warum ich eigentlich keinen Laptop habe. Tja, warum eigentlich?

Genau genommen habe ich ja noch ein Notebook: Mein JVC MP-XP741 von 2006 liegt hier noch. Ist halt nicht mehr ganz so up to date und das Linux ist auch schon ein paar Tage nicht aktualisiert worden… Ich nutze als Rechner aber tatsächlich ganz klassisch einen PC. Den habe ich immer wieder erweitert mit Festplatten/SSD und RAM. Und alles was länger als ein paar Minuten dauert mache ich eh am Schreibtisch. Am Sofa schnell mal was machen ist praktisch, aber einen Artikel wie diesen würde ich nie so tippen. Dafür ist mir mein Rücken zu schade.

Den PC habe ich also und der zweite wichtige Punkt ist, dass ich praktisch nicht zwei gleichwertige Geräte wie einen PC und Laptop parallel pflegen und aktuell halten würde. System- und Programmupdates sicher, aber ein Gerät wäre immer das Hauptgerät und das Andere hätte nicht alle Daten, im Detail eine andere Konfiguration und wäre eigentlich überflüssig. Ich brauche nicht zwei im Prinzip gleichwertige Geräte.

Ein Laptop oder Notebook wäre so lange ausquartiert aber schon praktisch gewesen . So musste es halt mit Smartphone, Tablet und einem Raspberry Pi gehen. Letzterer lag mitsamt der Fritzbox in der Wohnungsbaustelle in einer Plastiktüte um bei den Renovierungsarbeiten nicht beschädigt zu werden. So hatte ich aber zumindest ein “richtiges” (Arch) Linux im Zugriff.

. So musste es halt mit Smartphone, Tablet und einem Raspberry Pi gehen. Letzterer lag mitsamt der Fritzbox in der Wohnungsbaustelle in einer Plastiktüte um bei den Renovierungsarbeiten nicht beschädigt zu werden. So hatte ich aber zumindest ein “richtiges” (Arch) Linux im Zugriff.

Aber der Zustand nervte schon sehr und ich war kurz davor, mir doch ein Notebook zu kaufen. Ein refurbished Thinkpad hatte ich mir schon rausgesucht. Der ganze Black Friday/Cybermonday Angebotsirrsin näherte sich und ich war zu dem Entschluss gekommen, mir entweder ein refurbished Businessgerät zu holen oder evtl. ein neues Schnäppchen. Es sei denn, das Chromebook über das Volker geschrieben hatte, kommt ins Angebot. Denn das fand ich schon damals interessant, aber war seitdem verdammt preisstabil. Und ich hatte ja keine Not. Damals, vor der Flut…

Und siehe da, ein paar Tage vor dem Black Friday kam bei Amazon das Lenovo Chromebook C340-11 ins Angebot. Und ich habe beschlossen, es damit zu probieren. Und auch nach über 2 Monaten sehe ich es als die ideale Ergänzung für meine Nutzung…

Chromebooks sind als Geräteklasse schon älter, vor 10 Jahren hat Google sie als “Einfachlaptops” eingeführt. Wenn man eh komplett online arbeitet sollte ein Browser reichen. Das ist heute in Deutschland vielleicht in Großstädten oder an Orten mit gesicherter Onlineverbindung machbar, in den USA war das schon vor 10 Jahren weit genug, eine neue Geräteklasse zu erfinden.

In den USA – und wie ich hörte auch in Schweden – sind Chromebooks vor allem in den Schulen normal. Einfach, günstig und da sie noch immer grösstenteils online arbeiten muss man sich nur anmelden und hat seine gewohnte Umgebung, Mails, Dateien usw..

Chromebooks haben sich aber deutlich weiter entwickelt. Hardwareseitig geht es bis in die High-End Laptopklasse, für mich wichtiger ist aber die Softwareseite: Erst kam integrierter Speicher zum offline arbeiten hinzu, wichtiger aber: Chrome OS führt seit 2017 Android-Programme aus und seit letztem Jahr auch nativ Linuxprogramme. Das Chrome OS basiert (wie Android auch) auf einem Linux-Kernel, da ist das kein Hexenwerk. Androidprogramme laufen einfach, für die Linuxprogramme wird im Hintergrund ein Container mit Debian gestartet, die Programme laufen dann aber auch ganz normal.

Linux und Android – das ist genau das, was ich zu 97,8% nutze! Und das ist auch der Grund, warum das Chromebook für mich heute so gut funktioniert. Ohne Android und Linux wäre die Nutzung für mich zu eingeschränkt.

Das C340-11 ist ein Convertible, das bedeutet es sieht erstmal aus wie ein normaler (kleiner) Laptop aber man kann das Display “umschlagen”, so dass man es als Tablet nutzen kann. Das Chrome OS deaktiviert dann automatisch die nun auf der Rückseite liegende Tastatur und aktiviert eine Tabletansicht des Launchers, so dass man es wirklich wie ein Tablet nutzen kann.

Das C340-11 ist ein Convertible, das bedeutet es sieht erstmal aus wie ein normaler (kleiner) Laptop aber man kann das Display “umschlagen”, so dass man es als Tablet nutzen kann. Das Chrome OS deaktiviert dann automatisch die nun auf der Rückseite liegende Tastatur und aktiviert eine Tabletansicht des Launchers, so dass man es wirklich wie ein Tablet nutzen kann.

Auf halbem Weg kann man das Chromebook auch wie ein Zelt aufstellen und so z.B. Filme gucken. Auch hierbei wird die Tastatur deaktiviert und der Bildschirminhalt um 180° rotiert.

Ich habe nun also ein Gerät, das sowohl ein einfacher Laptop als auch Tablet ist. Es ist leistungsmässig keinesfalls eine Konkurrenz zu meinem PC, es ergänzt ihn aber wunderbar. Kleinigkeiten mache ich am Chromebook durchaus auf der Couch, für “mehr” gehe ich dann aber an den Schreibtisch.

Das Betriebssystem ist darauf ausgelegt online zu arbeiten, das muss aber nicht zwangsläufig mit den Google Diensten sein. In den Dateibrowser habe ich einfach meinen Raspberry Pi eingebunden und speichere Dinge auf der daran angschlossenen Festplatte. Da kann ich auch vom PC her einfach drauf zugreifen. Dessen Platte könnte ich natürlich auch einbinden, aber dann müsste der auch eingeschaltet sein. Der Pi läuft eh 24/7. Das Gerät hat aber auch genug (erweiterbaren) Speicher eingebaut, um offline arbeiten zu können.

Ebenso eingebunden habe ich die Nextcloud-Installation auf meinem Webspace. Nextcloud ist auch ein gutes Beispiel für die Android-Integration in Chrome OS: Für Androidprogramme ist Chrome OS eine weitere Geräteklasse wie “Smartphone” oder “Tablet”. Und sie können angepasst reagieren (oder die System-APIs setzen es um). Von Haus aus integriert sich die Android-Version von Nextcloud schon in den Dateibrowser von Chrome OS. Man kann Nextcloud-Accounts gleichberechtigt neben dem Google-Drive Laufwerk haben.

Wirklich anders reagiert hat Nextcloud aber, als ich eine 128GB SD-Karte in das Chromebook gesteckt habe: ohne weiteres zutun hat es quasi in einen “PC-Modus” umgeschaltet und angefangen, die Dateien aus der Nextcloud zu synchronisieren statt wie beim Smartphone nur explizit ausgewählte Dateien.

Es mag einfach ein geschickter Cachingmechanismus sein, aber Androidprogramme in Chrome OS verhalten sich sehr natürlich. Sie starten beim ersten mal als Hochkant-Fenster wie auf dem Smartphone, man kann es einfach maximieren wie auf einem Tablet oder auch frei in der Größe verändern wie auf einem PC. Und es funktioniert einfach.

Die Linuxunterstützung wird wie erwähnt durch eine Debianumgebung realisiert, die im Hintergrund läuft. Das Linux hat eine eigene virtuelle Festplatte, auf die das Chrome OS ganz normal zugreifen kann. Die SD-Karte ist ganz normal gemountet, die USB-unterstützung ist noch im fluss. Auf Android-Geräte kann man direkt aus dem Linux zugreifen, Wechselmedien werden als Verzeichnis gemountet. Zugriff auf das USB Gerät gibt es ansonsten nicht direkt für das Linux, da soll man aber auch etwas tricksen können. Final ist an der Stelle noch nichts und da ich es ehrlich gesagt noch nicht gebraucht habe, habe ich mich nicht näher damit beschäftigt.

Ansonsten ist es ein ziemlich normales Debian Buster. Programme, die man als .deb installiert erscheinen ganz normal im Launcher von Chrome OS und laufen transparent auf der Oberfläche. Der erste Start eines Linuxprogramms dauert ewas länger, weil im Hintergrund erst der Container gestartet wird.

Das mit dem Linuxcontainer hat auch reichlich Potenzial: Chrome OS kann mehrere parallel Containter verwalten und man kann sie auch wie virtuelle Maschinen verwalten. So habe ich schon einen Container mit Arch Linux parallel angelegt und hatte ich Chrome OS 78 den Standardcontainer auf Buster aktualisiert. Das kam “offiziell” erst mit Chrome OS 80. Da kann man wirklich viel mit spielen, muss es aber nicht. Linuxprogramme laufen fast genauso wie Androidprogramme einfach ganz natürlich. Die Integration von Android ist wirklich perfekt, Linux noch nicht ganz aber so gut, dass man es einfach nutzen kann. Da auch Android technisch als Container läuft dürfte die Intergration mit der Zeit auch noch die letzen Kanten verlieren.

Ich benutze Androidprogramme, Linuxprogramme und Chrome OS Programme bzw. Webansichten völlig durch- und miteinander. Das Gerät selbst zu 2/3 der Zeit wie ein Laptop und 1/3 wie ein Tablet. Als “Videozelt” bisher kaum. Chrome OS taugt wunderbar als ressourcenschonendes System, wer ansonsten Android und Linux nutzt, wie ich es tue, bekommt instantan ein fertig nutzbares Gerät.

Als “Videozelt” bisher kaum. Chrome OS taugt wunderbar als ressourcenschonendes System, wer ansonsten Android und Linux nutzt, wie ich es tue, bekommt instantan ein fertig nutzbares Gerät.

Alle anderen im übrigen auch, das System bootet in ~7 Sekunden zum Login. Anmelden kann man sich mit jedem Google-Account (kann man auch einschränken) und man sieht nach ein paar weiteren Sekunden seine Google-Umgebung mit E-Mail, Dateien, Chrome-Addons und Bookmarks usw.. Die ganzen Google Dienste muss man aber nicht benutzen. Das System ist darauf ausgelegt und wenn man sie nutzt kann man sich wirklich an jedem Chrome OS Gerät anmelden und sofort losarbeiten. Das macht es (in anderen Ländern) auch so beliebt an Schulen. Das einzige, was man von Google wirklich nutzen muss, ist der Login.

Chrome OS hat mich wirlich sehr positiv überrascht und überzeugt. Das Chromebook ist in meinen Augen genau das, was ich mir von einem Tablet versprochen habe. Als Tablet ist es mit ~1kg zwar relativ schwer, aber als Gerät ist es wie Tablet nutzbar oder wie ein Laptop. Die Wechselmöglichkeit nutze ich sehr gern und ich hätte das Verhältnis vorher genau andersrum vermutet. Aber ist ja wurscht, das umklappen dauert ‘ne Sekunde.